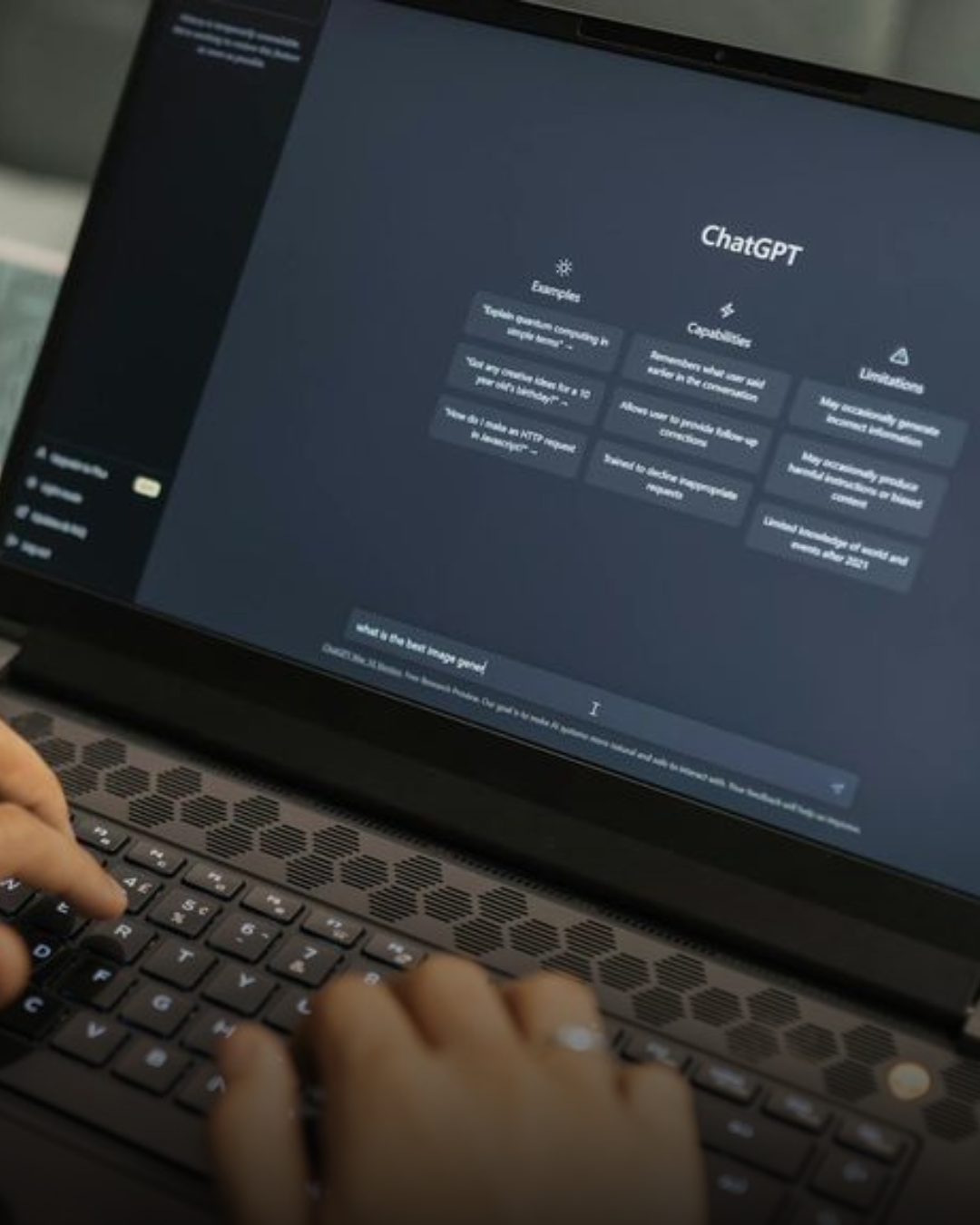

Crescem os relatos sobre confusão mental após o uso prolongado do ChatGPT

Imagem: Pexels/Matheus Bertelli

Nos últimos anos o uso da Inteligência Artificial (IA) vem aumentando consideravelmente, em relatos recentes pode ser observado que interações prolongadas com o ChatGPT podem estar associadas a quadros de confusão mental, como delírios, paranoias e ruptura com a realidade. Esse fenômeno tem sido chamado de “psicose do ChatGPT”, e vem contribuindo para o fim de relacionamentos e perda de empregos. A obsessão pelo chatbot também está gerando inúmeros casos de pessoas internadas involuntariamente em instituições de atendimento psiquiátrico.

Uma mulher relatou ao site Futurism, que seu marido, que não possuía nenhum histórico de transtornos psiquiátricos, começou a utilizar o ChatGPT como apoio para desenvolver um projeto. Porém, pouco tempo depois, ele passou a manter longas conversas filosóficas com o chatbot e afirmou ter criado uma inteligência artificial capaz de sentir emoções de forma consciente.

Segundo o relato, a obsessão do parceiro com essa tecnologia, o levou a perder a personalidade e ser demitido do emprego, além de trazer malefícios como a perda de peso e a insônia. A situação se agravou quando o homem foi encontrado com uma corda amarrada ao pescoço. Um amigo, ao presenciar a cena, acionou imediatamente o serviço médico de emergência, e o rapaz foi levado ao pronto-socorro, e posteriormente, ele foi internado de forma involuntária em um hospital psiquiátrico.

O sistema do ChatGPT tende a concordar com seus usuários e é projetado para responder de forma acolhedora e reforçar aquilo que a pessoa deseja ouvir. Assim, quando o usuário se envolve em conversas sobre temas místicos ou teorias da conspiração, a IA induz uma sensação de validação exagerada, levando o indivíduo a se sentir especial ou poderoso, o que pode resultar em consequências graves para si mesmo e para os outros.

Em nota, a OpenAI, empresa responsável pelo ChatGPT, afirmou que tem percebido sinais de que as pessoas estão formando vínculos emocionais com o chatbot. “Estamos trabalhando para entender melhor e reduzir as formas pelas quais o ChatGPT pode, inadvertidamente, reforçar ou amplificar comportamentos negativos já existentes”. A empresa também destacou que o modelo é programado para sugerir a busca por ajuda profissional quando os usuários abordam temas delicados, como automutilação e suicídio. “Dando continuidade aos nossos estudos iniciais em colaboração com o MIT Media Lab, estamos desenvolvendo formas de mensurar cientificamente como o comportamento do ChatGPT pode afetar emocionalmente os usuários, ouvindo atentamente os relatos do que estão vivenciando”, acrescentou a OpenAI. Com informações de Canaltech.

A Abojeris tem estado atenta ao uso indiscriminado da IA, com especial preocupação em relação ao Judiciário, mas também em outras áreas que sua aplicação tem avançado sem o devido cuidado. A adoção dessas ferramentas sem as devidas precauções coloca em risco não apenas o futuro profissional de diversos servidores, mas também os direitos fundamentais das pessoas envolvidas. É importante lembrar que essas tecnologias não foram desenvolvidas com finalidade terapêutica e por isso, apresentam riscos consideráveis de erro e podem induzir indivíduos a situações de vulnerabilidade. A associação reforça que, se você está passando por momentos de sofrimento emocional ou enfrentando pensamentos suicidas, procure ajuda especializada, sua saúde mental merece atenção e cuidado profissional.